An einem warmen Augusttag vergangene Woche stellt die EU-Kommission eine Studie auf ihre Website, deren Ergebnisse überhaupt nicht zum freundlichen Wetter in Brüssel passen. Das 74-seitige Papier zieht Bilanz über die Bemühungen großer Plattformen wie YouTube, Twitter und TikTok, russische Kriegspropaganda seit der Invasion der Ukraine zu stoppen. Das Fazit: Zwar hätten sich die Plattformen zu einer effektiven Bekämpfung von Desinformation verpflichtet, sie seien aber im Fall russischer Kriegspropaganda „auf systemischer Ebene gescheitert“.

Kurz nach Veröffentlichung der Studie fragte der Journalist Guénaël Pépin des französischen Mediums Contexte beim Pressedienst der Kommission an. Danach passierte etwas Merkwürdiges: die Studie verschwand aus dem Netz. Aber mehr dazu später.

Kampf gegen Desinformation ist umstritten

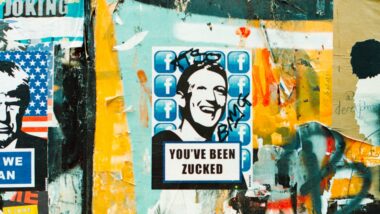

Seit 2018 verpflichten sich die größten Internetdienste der Welt im EU-Verhaltenskodex gegen Desinformation, die Ausbreitung von in bösartiger Absicht gestreuter Information zu bremsen. Entstanden ist der Kodex als Reaktion auf Vorwürfe, heimlich über Facebook und andere Plattformen verbreitete russische Propaganda habe das Brexit-Referendum und die Wahl von Donald Trump beeinflusst.

Der Begriff Desinformation umfasst Falschinformation und manipulierte Inhalte, etwa Deep-Fake-Videos. In gewissen Fällen meint er allerdings auch inhaltlich korrekte Behauptungen, die in einem manipulativen Kontext dargestellt werden. Wegen seiner schwammigen Definition gibt es immer wieder Kritik am Begriff. Der Kampf gegen tatsächliche und vermeintliche Falschnachrichten dürfe nicht dazu führen, dass Plattformen massenhaft erlaubte und legitime Formen der Meinungsäußerung löschten. Befürchtungen wecken auch Gesetze gegen „Desinformation“ in Ländern wie der Türkei, wo diese laut Befürchtungen von NGOs den Spielraum für Journalismus und die Zivilgesellschaft einschränken.

Unabhängig von dieser Kritik stärkte die EU ihren Verhaltenskodex 2022. Etwa verpflichteten sich die Unterzeichnenden, Factenchecks auf ihren Plattformen zu erlauben und Einnahmequellen aus Werbung für Propagandakonten zu kappen. Mit dem Digitale-Dienste-Gesetz wird die Einhaltung des Kodex, der bislang rein freiwillig war, durch Strafen kontrollierbar.

Die aus dem Internet verschwundene Studie der EU-Kommission untersuchte, ob die Maßnahmen von Facebook, Instagram, Youtube, Twitter, TikTok und Telegram den Anforderungen des neuen EU-Gesetzes zur Bekämpfung systemischer Risiken genügt hätte. Zu diesen Risiken zählt auch die ungebremste Ausbreitung von Desinformationskampagnen. Für die Untersuchung zuständig war die Generaldirektion Kommunikationsnetze, Inhalte und Technologien. Die Expert:innen untersuchten rund sieben Millionen Posts in einem Zeitraum von zwölf Monaten, die von aus Russland gesteuerten oder dem Kreml ideologisch nahestehenden Konten verbreitet wurden.

Studie bei netzpolitik.org im Volltext

Die Studie schlägt in politisch heikles Terrain, denn die meisten der großen Technologiekonzerne haben ihren Sitz in den USA, Europas wichtigstem geopolitischen Verbündeten. Dort wird der Versuch der EU, die Macht der Technologiekonzerne zu bändigen, mitunter skeptisch gesehen. Der zuständige Binnemarktkommissar Thierry Breton hat unterdessen wiederholt versucht, im persönlichen Gespräch Firmenchefs wie Twitter-Eigentümer Elon Musk von der Einhaltung der EU-Regeln zu überzeugen.

Laut der Untersuchung hat die russische „Z-Propaganda“ für ihren Einmarsch in die Ukraine seit März 2022 millionenfach Nutzer:innen in Europa erreicht, darunter sollen Aufrufe zur Gewalt gegen Ukrainer:innen gewesen sein. Schritte der Plattformen dagegen, etwa das Labeln und Blockieren einzelner Propaganda-Konten, seien von ihren Urheber:innen mühelos umgangen worden. Insgesamt hätten Pro-Kreml-Botschafter kaum weniger Publikum erreicht als ohne die Maßnahmen. Auch sei der Verhaltenskodex gegen Desinformation „nicht darauf ausgelegt, einen von tausenden koordiniert agierenden Konten geführten, großangelegten, staatlich geförderten Informationskrieg“ zu bekämpfen.

Die Studie soll als Vorlage für weitere Untersuchungen dienen, mit denen die Maßnahmen der großen Plattformen zur Bekämpfung „systemischer Risiken“ unter dem Digitale-Dienste-Gesetz beurteilt werden. Ob die Methodik der Untersuchung der komplexen Fragestellung immer gerecht wurde, können vermutlich bald unabhängige Forscher:innen beurteilen. Diese sollen ab nächstem Jahr einen rechtlichen Anspruch auf Zugang zu den Daten der Plattformen erhalten. Die Studie hatte teils darauf gesetzt, Millionen von Posts automatisiert mit einem von Google entwickelten Analysetool auf „Toxizität“ zu untersuchen.

Besprechen möchte die Kommission die Ergebnisse ihrer Untersuchung allerdings vorerst nicht. Auf Anfrage von netzpolitik.org hieß es, die Studie sei noch nicht fertig. „Sie wurde versehentlich veröffentlicht und zurückgezogen, sobald die Kollegen dies bemerkten“, schrieb ein Sprecher der EU-Kommission. Offen lässt die Kommission vorerst auch, welche möglichen Konsequenzen sie aus den Ergebnissen der fertigen Studien ziehen könnte. Wer sich selbst ein Bild über das unfertige Papier machen möchten, für den bieten wir es hier im Volltext zum Download.

Update vom 30. August 2023: Am Tag nach Veröffentlichung dieses Artikels hat die EU-Kommission die Studie ohne Änderungen wieder auf ihrer Website veröffentlicht. Der interne Prozess dazu sei abgeschlossen worden, schrieb uns ein Sprecher.

Interessant wäre es gewesen, wenn die EU die Untersuchung nicht auf Russland zugerechnete Kanäle beschränkt hätte, sondern alle, auch westlich Kanäle einbezogen hätte. Da gab es einige Desinformation und gestellte Videos. Schade, so ist es leider nur Propaganda.

das ist dann wohl die logische Konsequenz. Wer A sagt muss auch B sagen. Vielleicht würden dann Dinge „sichtbar“ die man nicht sehen möchte. (oder will das man sie sieht)

Auch ohne Verschwörungstheorien etc ist wohl allen klar wie manipulativ auch der große Bruder im Westen ist. Snowden lässt grüßen…. (Schade, dass es in Europa kein Land gibt was in solchen Dingen der USA widerstehen kann und er auf Russland angewiesen war/ist…)

Um russische Kriegs-Propaganda zu stoppen müsste man dann aber auch die Twitter Accounts von Linkspartei und AfD Politikern sperren. Das aber dürfte kaum rechtens sein denn es gilt ja „Meinungsfreiheit“…

Also ich sehe kaum wie man da die SocialMedia Betreiber wirklich wirkungsvoll in die Pflicht nehmen könnte.

Wieder mal ein wichtiges Dokument, dass vor der Öffentlichkeit versteckt wird. Warum?

Die Behauptung, es sei nicht fertig, ist angesichts der Qualität und des Umfangs der Studie wenig glaubwürdig.

Wissenschaft ist nie „fertig“. Und eine gängige Schlussformel lautet: „Weitere Studien zum Gegenstand sind notwendig“. Studien wegschließen jedoch, ist eine Praxis aus düsterer Vergangenheit.

> Kurz nach Veröffentlichung der Studie fragte der Journalist Guénaël Pépin des französischen Mediums Contexte beim Pressedienst der Kommission an.

Scheint eine Paywall zu sein, und mein Französisch wäre ohnehin nicht gut genug. Daher die freundliche Bitte an Alexander Fanta, dazu noch mitzuteilen, was denn genau dazu geführt, dass die Studie aus dem Netz verschwand. Hat der französische Journalist die Studie fachlich kritisiert? Welche Fragen hat er gestellt?

Dies wäre notwendig zu wissen, um sich ein Bild von dem Vorgang zu machen.

Ich glaube nicht, dass der französische Kollege die Studie kritisiert hat. Sondern wohl nur mal nachgefragt, was das für ein Papier ist und was die Kommission mit den Ergebnissen anfangen will. Meine Vermutung wäre, dass sie sich mit letztere Frage (noch) nicht befassen wollen.

Mit der Desinformation ist es wie mit der Darstellung von Nacktheit im Netz: vielen „Verantwortlichen“ scheint der Benutzer nicht fähig damit umzugehen, also muss es unterbunden werden. (wie wir alle wissen, sieht man das Problem bei der Darstellung von Gewalt und Waffen natürlich nicht).

In der Praxis gelingt das nicht, besser nie. Selbst kontrollierte Netze, wie in China, können keine umfassende Kontrolle durchsetzen.

Zudem bei der EU (wie allgemein) immer auch der Verdacht mitschwingt, inwieweit dort nicht selbst derart auf die Vermittlung von Informationen Einfluss genommen wird, das man darin „Desinformation“ sehen könnte.

Man nehme das Beispiel der Kritik an den Sanktionen gegen Russland, diese würden nicht wirken, die von EU-Institutionen wie euvsdisinfo.eu (eine Institution der East StratCom Task Force im Europäischen Auswärtigen Dienst) als russische „Desinformation“ bezeichnet werden (https://euvsdisinfo.eu/de/sanktionen-haben-keine-wirkung-russische-desinformationsnarrative-ueber-sanktionen-in-der-eu-in-der-ukraine-und-in-russland-selbst/). Womit unsere Außenministerin wohl in Gefahr gerät, eine „russische Desinformation“ von sich zu geben, da sie zunehmende Zweifel an der Wirksamkeit dieser kundtat.

Ein vernünftiger und freiheitlich-demokratischer Ansatz wäre für mich: den Benutzer befähigen – bei Nacktheit eben auch Jugendliche und Kinder (eh die Frage, was an Nacktheit problematisch ist?) – mit Informationen sorgfältig umzugehen und diese richtig einzuordnen. Dazu gehört aber die offene Auseinandersetzung eben auch mit falschen oder fehlerhaften oder nur teilweise fundierten Informationen – auch wenn das natürlich mühsam ist. Und die Verantwortlichen auch selbst in die Kritik geraten könnten